近日,OpenAI研究高级副总裁Mark Chen在炉边谈话中正式否认了“缩放定律墙理论”。

他表示,他还没有看到Scaling Law碰壁,甚至OpenAI也有两个例子——O系列和GPT系列来维持这种扩展。

用他的话说,“我们准确地抓住了需要解决的技术挑战。”

o1不仅是能力的提升,更是安全的提升

从财务角度来看,OpenAI 已经是最有价值的科技公司之一,因为它们为真实用户提供了数十亿美元的价值。

两年前,人工智能最前沿的任务是小学数学题;如今,他们已经可以解决博士生最困难的问题。

因此,我们正处于人工智能模型能够解决人类有史以来最困难的考试的阶段。

一旦这些模型解决了博士级别的问题,下一步就是为世界提供实用性和价值。

当所有基准都饱和时,接下来要考虑的是它是否为最终用户提供价值。

虽然今天的人工智能通过了基准测试,但它并没有完全体现通用人工智能应该做的事情。

幸运的是,在过去的一年里,OpenAI 内部发生了最激动人心的发展——o1 的诞生。

这不仅是能力的提升,更是根本性的安全提升。

为什么这么说?

想象一下,我们试图越狱一个模型,旧的 GPT 系统必须立即响应,因此可能更容易触发。

但是当我们有一个推理者时,模型就会反映出:这个问题是否试图让我做一些与我想做的事情不一致的事情?

这个时候,它获得额外的时间去思考和反思,将会使它在很多安全问题上变得更加稳健。

这也符合OpenAI研究人员的最初预期。

当我们谈论推理时,它是一个广泛的概念,不仅仅用于数学或编程。

编程中使用的推理方法也可能适用于谈判或玩困难的游戏。

在进行基准测试时,在安全性方面也存在同样的挑战。

安全性有点类似于这种对抗性攻击框架。在这种情况下,攻击力是非常强的,所以我们在这方面还有很长的路要走。

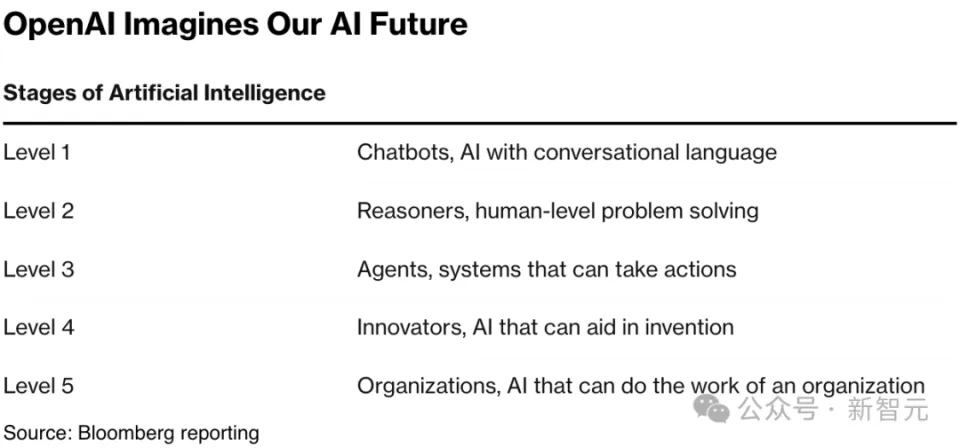

如何达到 5 级 AGI

AGI从Level 1迈向Level 5的关键驱动因素是什么?

OpenAI提出的框架中,定义了不同级别的AGI。具体来说,它们从基本的推理机发展到更智能的系统,再到可以在现实世界中采取行动的模型,最后发展到更加自主和完全自主的系统。 。

在这个过程中,鲁棒性和推理能力是关键。

今天我们不能依赖许多代理系统,因为它们不够可靠。这就是OpenAI押注于推理能力的原因。

OpenAI 投入了大量资金,因为它非常有信心推理能力将推动可靠性和稳健性。

那么,我们现在在哪里?

OpenAI研究人员认为,我们目前正在从第一阶段过渡到第二阶段,走向更加智能的系统。

尽管目前许多代理系统仍然需要人工监督,但它们正变得越来越自治。模型可以自己创建,我们对人工智能系统的信任逐渐增强。

综合数据的力量

合成数据是不是由人类直接生成的数据,而是由模型生成的数据。

有没有什么好方法来生成训练模型的合成数据?

我们在数据稀缺或质量低的数据集中看到了合成数据的力量。

例如,在训练 DALL-E 等模型时,会使用合成数据。

训练图像生成模型的一个核心问题是,当我们在互联网上查看带字幕的图像时,字幕与其描述的图像之间通常几乎没有相关性。

您可能会看到一张热气球的照片,并且标题并没有描述气球本身,而是类似“我度过的最美好的假期”之类的内容。

OpenAI 研究人员表示,在这种情况下,可以真正使用合成数据来训练可以为图像生成高保真字幕的模型。

然后可以为整个数据集重新生成捕获内容,OpenAI 已证明这是非常有效的。

该方法也可以用于数据集中某些方面较差的其他区域。

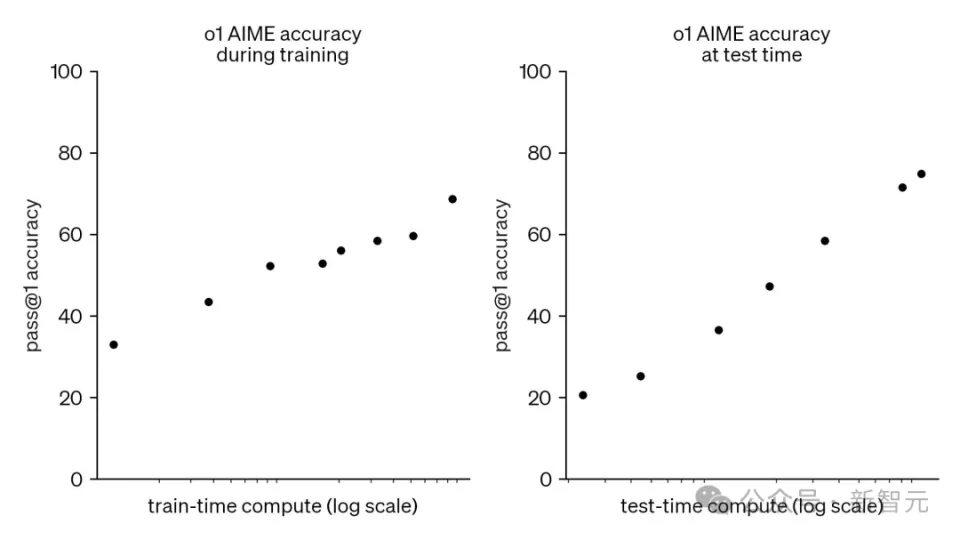

缩放法则不会碰壁

最近很流行的一个观点是,Scaling Law 碰壁了,很多大型基础实验室都遇到了预训练瓶颈。

这是真的吗?

Mark Chen的观点是,虽然在预训练方面确实遇到了一些瓶颈,但OpenAI内部的观点是已经有两个非常活跃的范式,这给了人们无限的希望。

他们在测试一系列模型时探索了扩展范式,发现它们确实增长得很快!

扩展推理模型不存在同样的障碍。

事实上,自从早期加入 OpenAI 以来,研究人员就遇到了多重技术挑战。现在这些挑战已经变得非常具体,在陈马克看来,没有什么是完全无法应对的。

在 OpenAI 内部,人们常说推理范式已经达到一定的成熟度。一些产品已经适应市场,但进展仍然非常缓慢。

过去几周最令人惊讶的用例是与 o1 的头脑风暴。

o1和GPT-4的对比让人感受到一种全新的深度:人类似乎终于有了一个可以真正互动的陪练伙伴,而不仅仅是评论自己的想法。

它感觉就像一个真实的实体并且非常有吸引力。

o1的推理直觉是如何产生的?

OpenAI 研究人员是如何得出 o1 中的推理直觉的?

这是集体努力的结果,但他们也做了很长时间的工作,做了一些探索性的关键尝试。

两年前,他们觉得AI虽然很聪明,但在某些方面还存在不足。不知道为什么,总感觉不像AGI。

他们当时推测,原因是人工智能被要求立即做出反应。

即使我们要求人类立即做出回应,他或她也可能无法给出最佳答案。

有人可能会说,我需要考虑一会儿,或者我需要做一些研究,明天再回复你。

正是在这里,OpenAI 研究人员发现了一个亮点!

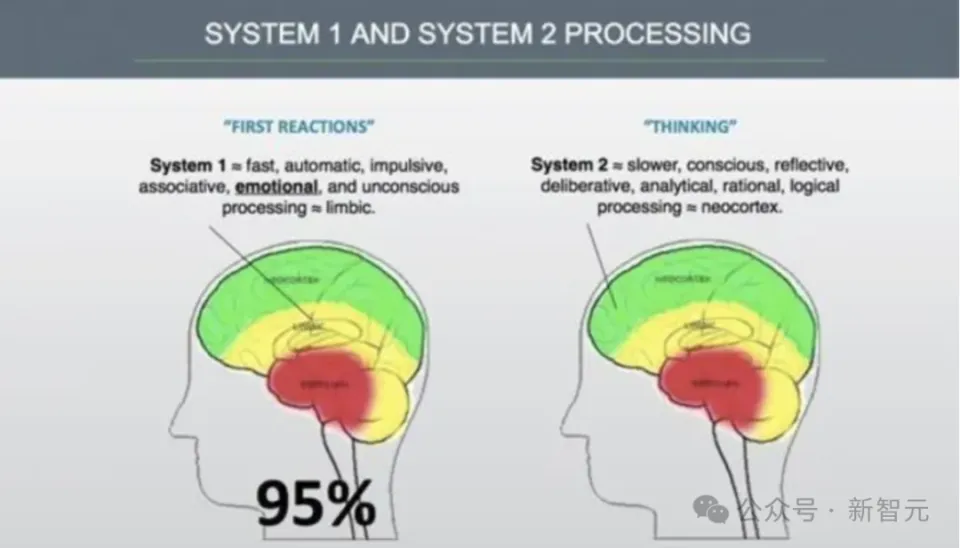

事实上,这里缺少的是系统1和系统2之间的差距。

有快速思维,有知识,但没有慢速思维。这是核心假设。

研究人员做出了许多不同的尝试来解决这一挑战。

一群极具探索性的研究人员已经获得了一些生命迹象。

围绕这些迹象,他们组建了研究团队,扩大了项目规模,并投入了大量的数据生成工作。

从快速进展中获得预测是整个案例中最困难的部分。

一开始,就像登月计划一样,会有很多失败。

三四个月来,他们几乎没有取得任何有意义的进展。

幸运的是,最终有人会取得重大突破。这也给了他们足够的动力去投入更多的资源,一点一点的推进。

o1推出几个月后,OpenAI与许多外部合作伙伴进行了沟通。

最酷的事情之一是他们发现它比使用微调方法要好得多 - 它已经不再被问题所困扰。

许多应用超出了研究人员之前关注的数学和科学领域。看到人工智能的推理能力可以推广到这些领域,确实令人惊讶。

例如,在医学领域,模型涉及形成假设,验证它们,然后在医学症状的判断中形成新的假设。

即使在研究人员并不特别关注的领域,例如医学和法律推理,模型也正在迅速进展。

他们还坚信,未来人工智能还会在其他未经检验的领域取得重大进展。

OpenAI 仍然专注于安全

Mark Chen 肯定了 OpenAI 仍然像早期一样致力于研究和安全。

为此,他管理着大量的研究项目。并且一直在思考应该分配多少资源和精力来进行探索性研究,而不是短期的立竿见影的项目。

不过,OpenAI在这方面与很多大型基础实验室有所不同。

这些大实验室有很多优秀的研究人员,他们可以无方向地进行研究,可以自由地做任何事情。

但对于OpenAI来说,他们比这些实验室规模小,所以需要更有方向性。

他们选择了一些非常有信心的探索性项目,给了研究人员在这些领域很大的自由度。

换句话说,OpenAI不会进行漫无目的的探索,而是充分利用了其小规模的优势。

现在是开展人工智能业务的好时机

OpenAI研究人员也认为,现在是建立基于AI的初创公司的好时机。

基础模型玩家注重多功能性。

但像OpenAI这样的公司不可能涉足每一个垂直领域。

在特定区域定制模型有很大的空间和可能性。

现在,我们已经可以看到一个丰富的初创公司生态系统,它们在 OpenAI 之上构建各种类型的应用程序。

通常,初创公司之所以成功,是因为他们知道并相信市场其他公司不知道的秘密。

在人工智能领域,我们实际上是在不断变化的技术堆栈上构建,我们无法预测下一个模型何时出现。

表现最好的初创公司是那些有直觉建立在刚刚开发出来的边缘技术之上的初创公司。他们有一种生命力。

当我们拥有通用人工智能时,它是一种非常强大的形式,可以真正释放全部潜力。

想象一下,一个人在一周内可以创建一家能够带来巨大价值的大型初创公司。

一个人在几天之内产生巨大影响的想法不再局限于商业。

这种怀旧的感觉就像17世纪科学家讨论物理的感觉。

我们能否回到一种可以在医学、物理学或计算机科学领域做出重大发现的氛围?

而这些都是因为AI。

参考:

本文采摘于网络,不代表本站立场,转载联系作者并注明出处:http://www.mjgaz.cn/fenxiang/272618.html